คนหรือ AI ควรใช้ดุลยพินิจได้แค่ไหน และเส้นไหนคือเส้นที่ไม่ควรข้าม

บทความนี้ตั้งคำถามที่ควรถูกถกกันอย่างจริงจังว่า AI ควรตัดสินใจอะไรได้แค่ไหน และเส้นไหนคือเส้นที่ไม่ควรข้าม โดยเฉพาะในกรณีที่การตัดสินใจมีนัยเชิงจริยธรรม กระทบชีวิต สิทธิ หรือศักดิ์ศรีของมนุษย์

ผู้เขียนเสนอกรอบคิดแบบง่ายที่แบ่งบทบาทของ AI ออกเป็นระดับ ตั้งแต่การเป็นเครื่องมือคำนวณ การเป็นผู้ช่วยเสนอคำแนะนำ การตัดสินใจอัตโนมัติที่ย้อนกลับได้ ไปจนถึง เส้นแดง คือการให้ AI ตัดสินใจเชิงจริยธรรมแทนมนุษย์ ซึ่งไม่ควรถูกยอมรับ

หลักคิดสั้น ๆ ของบทความนี้ชัดมาก: ถ้าผลลัพธ์ย้อนกลับไม่ได้ อธิบายต่อสาธารณะไม่ได้ หรือไม่มีใครรับผิดแทน AI ได้ ก็ไม่ควรให้ AI เป็นผู้ตัดสินใจ นี่คือการดึงประเด็น AI ethics กลับมาสู่เรื่องความรับผิดรับชอบและความอธิบายได้ของระบบ

ในองค์กร ปัญหามักไม่ใช่ตัว AI แต่คือมนุษย์ในลูปที่มี objective อื่น

จุดที่น่าสนใจมากคือผู้เขียนโยงกลับมาว่า ในหลายองค์กรรวมถึงมหาวิทยาลัย ปัญหาบ่อยครั้งไม่ได้อยู่ที่ตัว AI แต่อยู่ที่มนุษย์ในลูป ที่เข้ามาพร้อม objective นอกเหนือจากเป้าหมายของระบบ เช่น อำนาจ เครือข่าย หรือการสืบทอดตำแหน่ง

มุมนี้ทำให้บทความขยับจากจริยธรรมของ AI ไปสู่จริยธรรมของสถาบัน และชี้ว่าการมี human-in-the-loop ไม่ได้แปลว่าระบบจะดีเสมอไป หากมนุษย์คนนั้นเองก็ไม่ได้ทำงานเพื่อ objective ของระบบ

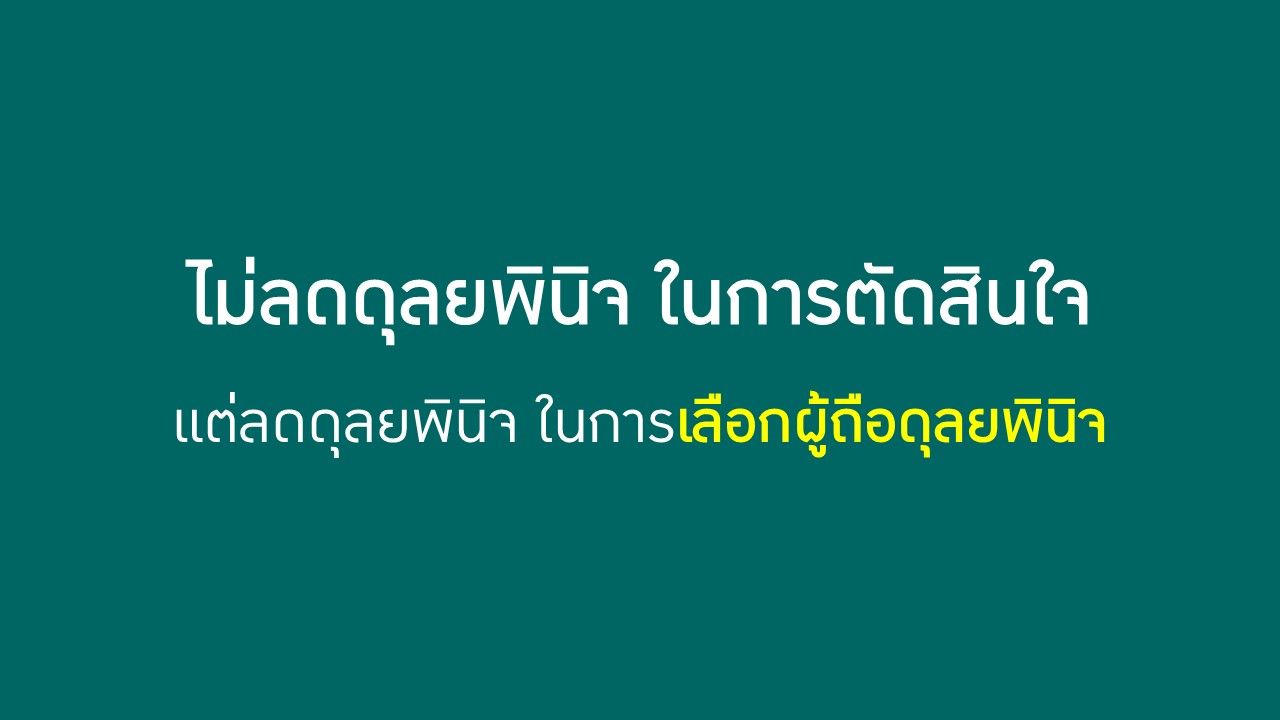

สิ่งที่ควรลดไม่ใช่ดุลยพินิจทั้งหมด แต่คือดุลยพินิจในการเลือกผู้ถือดุลยพินิจ

ข้อเสนอที่คมที่สุดของโพสต์คือ เราอาจไม่ควรลดบทบาทของดุลยพินิจในการตัดสินใจทุกกรณี แต่ควรลดบทบาทของดุลยพินิจในการเลือกคนที่จะมาใช้ดุลยพินิจ ให้มากที่สุด โดยพึ่งพาเกณฑ์ ระบบ และความโปร่งใสแทน

ตัวอย่างเรื่องการเลือกตัวแทนคณบดีและข้อเสนอว่า หากผู้ผ่านการคัดกรองมีคุณสมบัติใกล้เคียงกัน การสุ่มอย่างเป็นระบบ อาจยุติธรรมกว่าการเปิดพื้นที่ให้เครือข่ายหรืออคติแทรก แสดงให้เห็นว่าเป้าหมายของระบบที่ดีไม่ใช่การกำจัด judgment แต่คือการออกแบบเงื่อนไขให้ judgment ถูกใช้ในจุดที่เหมาะและตรวจสอบได้